Muhtemelen etik yapay zeka hakkında konuşan insanları duymuş veya okumuşsunuzdur. Bilgisayarlar aslında düşünemese ve bu nedenle gerçek bir önyargıya veya sorumluluk duygusuna sahip olmasa da, onlara güç veren yazılımı geliştiren insanlar kesinlikle bunu yapıyor ve onu önemli kılan da bu.

Tanımlanması ya da fark edilmesi kolay bir şey değil. Bu, yapay zeka tarafından desteklenen, tüketiciye yönelik ürünler geliştiren büyük teknoloji şirketlerinin bunu doğru yapmasının ne kadar hayati olduğu gerçeğini ortadan kaldırmıyor. Yapay zekanın hayatlarımızı kötüleştirmek yerine daha iyi hale getirmesini sağlamak için bunun ne olduğuna ve neler yapıldığına bir göz atalım.

Yapay zeka, bir şeyi alıp işleyen ve başka bir şeyi ortaya çıkaran bir yazılım yığınından başka bir şey değildir. Aslında tüm yazılımların yaptığı budur. Yapay zekayı farklı kılan şey, çıktının girdiden son derece farklı olabilmesidir.

Android ve Rahatlama

Web'in en uzun süredir devam eden teknoloji sütunlarından biri,

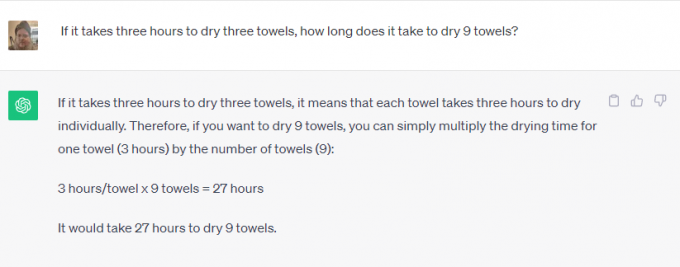

Android ve Rahatlama Cumartesi günleri Android, Google ve teknolojiyle ilgili her şey hakkındaki tartışmanızdır.Almak SohbetGPT veya Google Ozanı örneğin. Matematik problemlerini çözmenizi, internetten bir şeyler aramanızı, Elvis Presley'in hangi gün öldüğünü söylemenizi veya Katolik kilisesinin tarihi hakkında kısa bir hikaye yazmanızı isteyebilirsiniz. Kimse kullanabileceğini düşünmezdi Telefonunuz bunun için birkaç yıl önce.

Bunlardan bazıları oldukça kolay görevlerdir. İnternet ile entegre olan yazılım, herhangi bir şey hakkında bilgi alabilir ve bunu bir sorguya yanıt olarak geri aktarabilir. Harika çünkü zamandan tasarruf sağlıyor ama gerçekten şaşırtıcı değil.

Ancak bunlardan biri farklı. Yazılım, Google'da aranabilecek bir şey olmayan, insan tavırlarını ve konuşmasını kullanan anlamlı içerik oluşturmak için kullanılır. Yazılım, ne sorduğunuzu (bana bir hikaye yazın) ve bunun için kullanılacak parametreleri (Katolik kilisesi hakkındaki tarihi veriler) tanıyor ancak geri kalanı harika görünüyor.

İster inanın ister inanmayın, sorumlu gelişim her iki kullanım türünde de önemlidir. Yazılım hiçbir şeye sihirli bir şekilde karar vermez ve tarafsız (imkansız) veya her taraftan eşit derecede önyargılı kaynaklar kullanılarak sorumlu bir şekilde eğitilmesi gerekir.

Bard'ın, Elvis'in hâlâ hayatta olduğunu düşünen birini öldüğü gün için tek kaynak olarak kullanmasını istemezsiniz. Ayrıca Katolik kilisesinden nefret eden birinin onun hakkında hikaye yazacak bir yazılım programlamasını da istemezsiniz. Her iki bakış açısının da dikkate alınması ve diğer geçerli bakış açılarına göre tartılması gerekir.

Etik, insanın doğal önyargılarını kontrol altında tutmak kadar önemlidir. Bir şey geliştirebilen bir şirketin, bunun sorumlu bir şekilde kullanıldığından emin olması gerekir. Eğer bunu yapamıyorsa hiç geliştirmemesi gerekiyor. Bu, yönetilmesi çok daha zor olan kaygan bir zemin.

Karmaşık yapay zeka yazılımı geliştiren şirketler bunun farkında ve ister inanın ister inanmayın, çoğunlukla bazı şeylerin yapılmaması gerektiğini söyleyen kurala uyuyorlar. olabilmek yapılacak.

Yapay zekanın sorumlu bir şekilde kullanıldığından emin olmak için neler yapıldığı konusunda hem Microsoft'a hem de Google'a ulaştım. Microsoft bana paylaşacak yeni bir şeyleri olmadığını söyledi ancak beni konuyla ilgili bir dizi kurumsal bağlantıya ve blog yazısına yönlendirdi. bunları okumak Microsoft'un kararlıdır Mevcut ABD politikası ve ana hatlarına uygun olarak "gelişmiş yapay zeka sistemlerinin emniyetli, emniyetli ve güvenilir olmasını sağlayın" iç standartları çok detaylı. Microsoft'un şu anda tam bir ekibi var Sorumlu yapay zeka üzerinde çalışıyor.

Buna karşılık Google'ın halihazırda yayınlanmış açıklamalarına ek olarak söyleyecek çok şeyi var. Geçtiğimiz günlerde, kıdemli Google çalışanlarının önemli olan tek yapay zeka yarışının sorumlu yapay zeka yarışı olduğunu söylediği konuyla ilgili bir sunuma katıldım. Bir şeyin teknik olarak mümkün olmasının bir ürüne yeşil ışık yakılması için yeterince iyi bir neden olmadığını açıkladılar: zararlar Geliştirme sürecinin bir parçası olarak tanımlanmaları ve hafifletilmeleri gerekir, böylece daha sonra bunları daha da iyileştirmek için kullanılabilirler. işlem.

Yüz tanıma ve duygusal algılama örnek olarak verilmiştir. Google her ikisinde de gerçekten çok iyi ve buna inanmıyorsanız şuna bir göz atın: Google Foto kendi resimlerinizde belirli bir kişiyi veya mutlu insanları arayabileceğiniz yer. Bu aynı zamanda potansiyel müşterilerin talep ettiği bir numaralı özelliktir ancak Google bu özelliği daha da geliştirmeyi reddediyor. Potansiyel zarar, Google'ın bunun için para almayı reddetmesi için yeterlidir.

Google da hem hükümet düzenlemelerinden hem de iç düzenlemelerden yanadır. Bu hem şaşırtıcı hem de önemli çünkü hiçbir şirketin yaratamayacağı eşit bir oyun alanı var. Zararlı yapay zeka, hem Google'ın hem de Microsoft'un herhangi bir potansiyel gelirden daha ağır bastığını düşündüğü bir şeydir. finansal kazanç.

Beni en çok etkileyen şey, doğruluk ile etik arasında denge kurulması konusunu sorduğumda Google'ın verdiği yanıttı. Bitki tanımlaması gibi bir şey için doğruluk çok önemlidir, önyargı daha az önemlidir. Bir fotoğrafta birinin cinsiyetini belirlemek gibi bir şey için her ikisi de eşit derecede önemlidir. Google, yapay zekayı dilimler adını verdiği parçalara ayırır; her dilim farklı bir şey yapıyor ve sonuç, gerçek insanlardan oluşan bir ekip tarafından değerlendirilerek sonuçları kontrol ediliyor. Ekip tatmin olana kadar ayarlamalar yapılır, daha sonra daha fazla gelişme yapılabilir.

Bunların hiçbiri mükemmel değil ve hepimiz yapay zekanın çok aptalca, hatta bazen incitici şeyler yaptığını veya tekrarladığını gördük. Bu önyargılar ve etik ihlaller tek bir üründe yer buluyorsa, hepsinde de bulunabilir (ve bulunur).

Önemli olan geleceğin yazılımlarını geliştiren şirketlerin bunu fark etmesi ve süreci iyileştirmeye çalışmasıdır. Hiçbir zaman mükemmel olmayacak ama her yineleme bir öncekinden daha iyi olduğu sürece doğru yönde ilerliyoruz.