Je hebt waarschijnlijk mensen horen of lezen die praten over ethische AI. Hoewel computers niet echt kunnen denken en dus geen daadwerkelijke vooroordelen of verantwoordelijkheidsgevoel hebben, kunnen de mensen die de software ontwikkelen die dit allemaal aanstuurt dat zeker wel, en dat maakt het zo belangrijk.

Het is niet eenvoudig om het te beschrijven of op te merken. Dat neemt niets weg van hoe belangrijk het is dat grote technologiebedrijven die op de consument gerichte producten ontwikkelen die worden aangedreven door AI, het goed doen. Laten we eens kijken naar wat het is en wat er wordt gedaan om ervoor te zorgen dat AI ons leven beter maakt in plaats van slechter.

AI is niets meer dan een stuk software dat iets opneemt, verwerkt en weer iets anders uitspuugt. Eigenlijk is dat wat alle software doet. Wat AI anders maakt, is dat de output enorm kan verschillen van de input.

Android en Chill

Een van de langstlopende technische columns op internet, Android en Chill

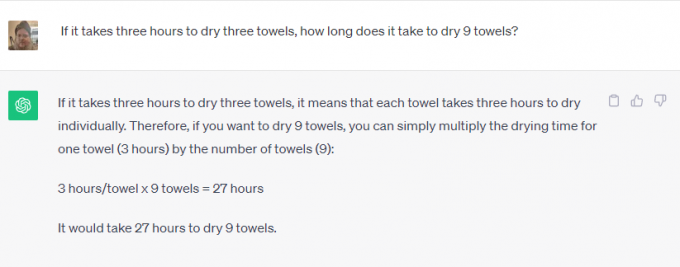

is je zaterdagbespreking over Android, Google en alles wat met technologie te maken heeft.Nemen ChatGPT of Google Bard bijvoorbeeld. Je kunt vragen om wiskundige problemen op te lossen, iets op internet op te zoeken, je te vertellen op welke dag Elvis Presley stierf, of je een kort verhaal te schrijven over de geschiedenis van de katholieke kerk. Niemand had gedacht dat je het kon gebruiken jouw telefoon hiervoor een paar jaar geleden.

Sommige daarvan zijn vrij gemakkelijke taken. Software die met internet is geïntegreerd, kan informatie over alles ophalen en deze teruggeven als antwoord op een vraag. Het is geweldig omdat het tijd kan besparen, maar het is niet echt geweldig.

Eén van die dingen is echter anders. Software wordt gebruikt om betekenisvolle inhoud te creëren waarin gebruik wordt gemaakt van menselijke manieren en spraak, iets wat niet op Google kan worden opgezocht. De software herkent wat je vraagt (schrijf me een verhaal) en de parameters die daarvoor moeten worden gebruikt (historische gegevens over de katholieke kerk), maar de rest lijkt verbazingwekkend.

Geloof het of niet, verantwoorde ontwikkeling is van belang bij beide soorten gebruik. Software beslist niet op magische wijze iets en moet op verantwoorde wijze worden getraind, waarbij gebruik wordt gemaakt van bronnen die onbevooroordeeld (onmogelijk) of van alle kanten even bevooroordeeld zijn.

Je wilt niet dat Bard iemand gebruikt die denkt dat Elvis nog leeft als enige bron voor de dag dat hij stierf. Je zou ook niet willen dat iemand die de katholieke kerk haat, software programmeert om er een verhaal over te schrijven. Beide standpunten moeten in overweging worden genomen en worden afgewogen tegen andere geldige standpunten.

Ethiek is net zo belangrijk als het onder controle houden van natuurlijke menselijke vooroordelen. Een bedrijf dat iets kan ontwikkelen, moet ervoor zorgen dat het op een verantwoorde manier wordt gebruikt. Als het dat niet kan, moet het het helemaal niet ontwikkelen. Dat is een hellend vlak, dat veel moeilijker te beheersen is.

De bedrijven die ingewikkelde AI-software ontwikkelen zijn zich hiervan bewust en geloven het of niet, maar volgen meestal de regel die zegt dat sommige dingen gewoon niet gemaakt mogen worden, zelfs als ze kan gemaakt zijn.

Ik heb contact opgenomen met zowel Microsoft als Google over wat er wordt gedaan om ervoor te zorgen dat AI op verantwoorde wijze wordt gebruikt. Microsoft vertelde me dat ze niets nieuws te delen hadden, maar verwees me naar een reeks bedrijfslinks en blogposts over dit onderwerp. als je ze doorleest, blijkt dat Microsoft is toegewijd aan "ervoor zorgen dat geavanceerde AI-systemen veilig, beveiligd en betrouwbaar zijn" in overeenstemming met het huidige Amerikaanse beleid en de contouren zijn interne normen tot in de kleinste details. Microsoft heeft momenteel een heel team werken aan verantwoorde AI.

Google heeft daarentegen genoeg te zeggen naast de reeds gepubliceerde uitspraken. Ik heb onlangs een presentatie over dit onderwerp bijgewoond waarin senior Google-medewerkers zeiden dat de enige AI-race die er toe doet, de race om verantwoorde AI is. Ze legden uit dat het feit dat iets technisch mogelijk is, geen goede reden is om een product groen licht te geven: schade moeten worden geïdentificeerd en verzacht als onderdeel van het ontwikkelingsproces, zodat ze vervolgens kunnen worden gebruikt om dat verder te verfijnen proces.

Als voorbeelden werden gezichtsherkenning en emotionele detectie gegeven. Google is erg goed in beide en als je dat niet gelooft, kijk dan eens naar Google Foto's waar u kunt zoeken naar een specifiek persoon of naar gelukkige mensen in uw eigen foto's. Het is ook de belangrijkste functie waar potentiële klanten om vragen, maar Google weigert deze verder te ontwikkelen. De potentiële schade is voldoende voor Google om te weigeren er geld voor te accepteren.

Ook Google is voorstander van zowel overheidsregulering als interne regulering. Dat is zowel verrassend als belangrijk, omdat er een gelijk speelveld ontstaat dat geen enkel bedrijf kan creëren Schadelijke AI is iets waarvan zowel Google als Microsoft denken dat het opweegt tegen eventuele potentiële inkomsten financiële winst.

Wat de meeste indruk op mij maakte, was het antwoord van Google toen ik vroeg naar de balans tussen nauwkeurigheid en ethiek. Voor zoiets als plantidentificatie is nauwkeurigheid erg belangrijk, terwijl bias minder belangrijk is. Voor zoiets als het identificeren van iemands geslacht op een foto zijn beide even belangrijk. Google verdeelt AI in wat het segmenten noemt; elk segment doet iets anders en de uitkomst wordt geëvalueerd door een team van echte mensen om de resultaten te controleren. Aanpassingen worden doorgevoerd totdat het team tevreden is, waarna verdere ontwikkeling kan plaatsvinden.

Niets van dit alles is perfect en we hebben AI allemaal hele domme dingen zien doen of herhalen, soms zelfs kwetsende dingen. Als deze vooroordelen en ethische inbreuken hun weg kunnen vinden naar één product, kunnen ze ook hun weg vinden naar alle producten (en zullen dat ook doen).

Wat belangrijk is, is dat de bedrijven die de software van de toekomst ontwikkelen dit onderkennen en blijven proberen het proces te verbeteren. Het zal nooit perfect zijn, maar zolang elke iteratie beter is dan de vorige, gaan we in de goede richting.