Vjerojatno ste čuli ili čitali kako ljudi govore o etičkoj umjetnoj inteligenciji. Iako računala zapravo ne mogu razmišljati i stoga nemaju stvarne predrasude ili osjećaja odgovornosti, ljudi koji razvijaju softver koji sve to pokreće sigurno misle i to je ono što ga čini važnim.

Nije to lako opisati ni primijetiti. To ništa ne umanjuje koliko je važno da velike tehnološke tvrtke koje razvijaju proizvode namijenjene potrošačima koje pokreće AI, rade to kako treba. Pogledajmo što je to i što se poduzima kako bismo bili sigurni da AI čini naše živote boljim, a ne gorim.

AI nije ništa više od dijela softvera koji nešto prima, obrađuje i izbacuje nešto drugo. Zaista, to je ono što sav softver radi. Ono što AI čini drugačijim je to što se izlaz može jako razlikovati od ulaza.

Android i opuštanje

Jedna od najdugovječnijih kolumni o tehnologiji na webu, Android i opuštanje vaša je subotnja rasprava o Androidu, Googleu i svemu što se tiče tehnologije.

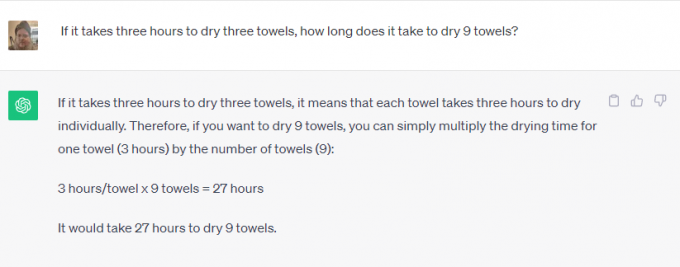

Uzeti ChatGPT ili Google Bard

na primjer. Možete tražiti da riješite matematičke zadatke, potražite nešto na webu, kažete vam koji je dan umro Elvis Presley ili vam napiše kratku priču o povijesti Katoličke crkve. Nitko ne bi pomislio da možeš koristiti tvoj telefon za ovo prije nekoliko godina.Neki od njih su prilično laki zadaci. Softver koji je integriran s internetom može dohvatiti informacije o bilo čemu i povratiti ih kao odgovor na upit. Sjajno je jer može uštedjeti vrijeme, ali nije baš nevjerojatno.

Jedna od tih stvari ipak je drugačija. Softver se koristi za stvaranje smislenog sadržaja koji koristi ljudske manire i govor, što nije nešto što se može potražiti na Googleu. Softver prepoznaje ono što tražite (napišite mi priču) i parametre koji će se za to koristiti (povijesni podaci o Katoličkoj crkvi), ali ostalo se čini nevjerojatnim.

Vjerovali ili ne, odgovoran razvoj važan je u obje vrste uporabe. Softver ne odlučuje ništa magično i mora se odgovorno trenirati, koristeći izvore koji su ili nepristrani (nemoguće) ili jednako pristrani sa svih strana.

Ne želite da Bard koristi nekoga tko misli da je Elvis još uvijek živ kao jedini izvor informacija o danu njegove smrti. Također ne biste htjeli da netko tko mrzi Katoličku crkvu programira softver koji se koristi za pisanje priče o njoj. Oba gledišta treba razmotriti i odvagnuti u odnosu na druga valjana gledišta.

Etika je važna jednako kao i držanje prirodne ljudske pristranosti pod kontrolom. Tvrtka koja može nešto razviti mora se pobrinuti da se to koristi odgovorno. Ako to ne može, ne treba ga uopće razvijati. To je skliska padina — s kojom je puno teže upravljati.

Tvrtke koje razvijaju zamršeni AI softver svjesne su toga i vjerovali ili ne, uglavnom slijede pravilo da se neke stvari jednostavno ne bi trebale raditi čak i ako limenka biti napravljen.

Obratio sam se i Microsoftu i Googleu o tome što se poduzima kako bi se AI koristila odgovorno. Microsoft mi je rekao da nemaju ništa novo za podijeliti, ali me uputio na niz korporativnih poveznica i postova na blogu o toj temi. njihovo čitanje pokazuje da Microsoft je predan "osigurati da su napredni AI sustavi sigurni, zaštićeni i pouzdani" u skladu s trenutnom politikom i okvirima SAD-a svojim internim standardima vrlo detaljno. Microsoft trenutno ima cijeli tim radi na odgovornoj umjetnoj inteligenciji.

Nasuprot tome, Google ima mnogo toga za reći uz svoje već objavljene izjave. Nedavno sam prisustvovao prezentaciji o temi u kojoj su stariji zaposlenici Googlea rekli da je jedina bitna utrka AI-ja utrka za odgovornu umjetnu inteligenciju. Objasnili su da samo zato što je nešto tehnički moguće nije dovoljno dobar razlog za davanje zelenog svjetla proizvodu: šteta treba identificirati i ublažiti kao dio razvojnog procesa kako bi se potom mogli koristiti za daljnje usavršavanje toga postupak.

Kao primjeri navedeni su prepoznavanje lica i emocionalna detekcija. Google je stvarno dobar u oba, a ako ne vjerujete u to, pogledajte Google fotografije gdje možete tražiti određenu osobu ili sretne ljude na svojim slikama. To je također značajka broj jedan koju traže potencijalni kupci, ali Google je odbija dalje razvijati. Potencijalna šteta je dovoljna da Google odbije uzeti novac za nju.

Google također podržava i vladine propise kao i interne propise. To je i iznenađujuće i važno jer nijedna tvrtka ne može stvoriti jednake uvjete štetna umjetna inteligencija nešto je za što i Google i Microsoft misle da nadmašuje svaki potencijalni prihod ili financijski dobitak.

Ono što me se najviše dojmilo bio je Googleov odgovor na moje pitanje o balansiranju točnosti i etike. Za nešto poput identifikacije biljaka, točnost je vrlo važna dok je pristranost manje važna. Za nešto poput identifikacije nečijeg spola na fotografiji oboje je jednako važno. Google rastavlja AI na ono što naziva kriškama; svaki odsječak radi drugačije, a ishod procjenjuje tim stvarnih ljudi kako bi provjerili rezultate. Prilagodbe se rade dok tim ne bude zadovoljan, a zatim se može dogoditi daljnji razvoj.

Ništa od ovoga nije savršeno i svi smo vidjeli da AI radi ili ponavlja vrlo glupe stvari, ponekad čak i štetne stvari. Ako te predrasude i etička kršenja mogu pronaći svoj put u jedan proizvod, mogu (i čine) pronaći svoj put u sve njih.

Ono što je važno jest da tvrtke koje razvijaju softver budućnosti to prepoznaju i nastave pokušavati poboljšati proces. Nikada neće biti savršeno, ali sve dok je svaka iteracija bolja od prethodne, idemo u pravom smjeru.