Olete ilmselt kuulnud või lugenud inimesi rääkimas eetilisest tehisintellektist. Kuigi arvutid ei suuda tegelikult mõelda ja neil puudub seega tegelik eelarvamus või vastutustunne, siis seda kõike käivitavat tarkvara arendavad inimesed seda kindlasti teevad ja see teebki selle oluliseks.

Seda pole lihtne kirjeldada ega märgata. See ei võta midagi maha sellest, kui oluline on, et suured tehnoloogiaettevõtted, kes arendavad tehisintellekti toel tarbijatele suunatud tooteid, teeksid seda õigesti. Vaatame, mis see on ja mida tehakse selleks, et tehisintellekt muudaks meie elu paremaks, mitte halvemaks.

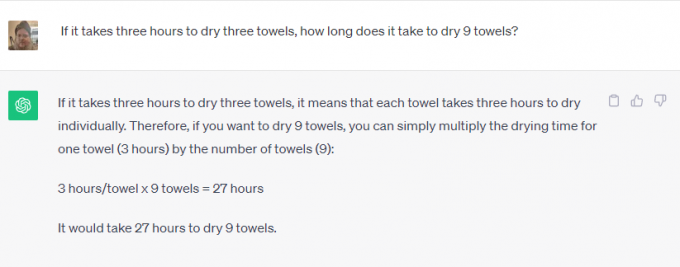

AI pole midagi muud kui tükk tarkvara, mis võtab midagi sisse, töötleb seda ja sülitab välja midagi muud. Tõesti, seda teeb kogu tarkvara. AI teeb teistsuguseks see, et väljund võib sisendist metsikult erineda.

Android ja Chill

Üks veebi pikima tööga tehnikaveergudest, Android ja Chill on teie laupäevane arutelu Androidist, Google'ist ja kõigest tehnikast.

Võtke ChatGPT või

Google Bard näiteks. Võite paluda lahendada matemaatikaülesandeid, otsida midagi veebist, öelda, mis päeval Elvis Presley suri, või kirjutada teile lühikese loo katoliku kiriku ajaloost. Keegi poleks arvanud, et saate seda kasutada sinu telefon selle eest paar aastat tagasi.Mõned neist on üsna lihtsad ülesanded. Internetti integreeritud tarkvara võib hankida teavet kõige kohta ja seda vastusena päringule tagasi tuua. See on suurepärane, sest see võib aega säästa, kuid see pole tegelikult hämmastav.

Üks neist asjadest on aga erinev. Tarkvara kasutatakse sisuka sisu loomiseks, mis kasutab inimlikke kombeid ja kõnet, mida Google'ist ei saa otsida. Tarkvara tunneb ära, mida te küsite (kirjutage mulle lugu) ja selle jaoks kasutatavad parameetrid (katoliku kiriku ajaloolised andmed), kuid muu tundub hämmastav.

Uskuge või mitte, vastutustundlik arendus on mõlema kasutusviisi puhul oluline. Tarkvara ei otsusta võluväel midagi ja seda tuleb koolitada vastutustundlikult, kasutades allikaid, mis on kas erapooletud (võimatud) või võrdselt kallutatud igast küljest.

Sa ei taha, et Bard kasutaks surmapäeva ainsa allikana kedagi, kes arvab, et Elvis on veel elus. Samuti ei tahaks, et keegi, kes katoliku kirikut vihkab, programmeeriks tarkvara, mida kasutatakse selle kohta loo kirjutamiseks. Mõlemat seisukohta tuleb kaaluda ja kaaluda teiste kehtivate seisukohtadega.

Eetika on sama oluline kui inimese loomuliku eelarvamuse kontrolli all hoidmine. Ettevõte, kes suudab midagi arendada, peab tagama, et seda kasutatakse vastutustundlikult. Kui ta seda ei suuda, ei pea ta seda üldse arendama. See on libe tee, mida on palju raskem juhtida.

Ettevõtted, kes arendavad keerulist tehisintellekti tarkvara, on sellest teadlikud ja usuvad või mitte, kuid järgivad enamasti reeglit, et mõnda asja lihtsalt ei tohiks teha, isegi kui saab teha.

Võtsin ühendust nii Microsofti kui ka Google'iga, et teada saada, mida tehakse tehisintellekti vastutustundliku kasutamise tagamiseks. Microsoft ütles mulle, et neil pole midagi uut jagada, kuid juhatas mind sellel teemal olevate ettevõtete linkide ja ajaveebipostituste seeriale. nende läbi lugemine näitab, et Microsoft on pühendunud "tagama, et täiustatud AI-süsteemid oleksid turvalised, turvalised ja usaldusväärsed" vastavalt USA kehtivale poliitikale ja põhijoontele selle sisestandardid väga detailselt. Microsoftil on praegu terve meeskond vastutustundliku AI kallal töötamine.

Seevastu Google'il on lisaks juba avaldatud väidetele palju öelda. Osalesin hiljuti selleteemalisel esitlusel, kus Google'i vanemad töötajad ütlesid, et ainus oluline tehisintellekti võidujooks on võistlus vastutustundliku AI eest. Nad selgitasid, et see, et midagi on tehniliselt võimalik, ei ole piisavalt hea põhjus toote roheliseks valgustamiseks: kahju tuleb arendusprotsessi osana tuvastada ja leevendada, et neid saaks seejärel kasutada selle edasiseks täiustamiseks protsessi.

Näitena toodi näotuvastus ja emotsioonide tuvastamine. Google on mõlemas väga hea ja kui te seda ei usu, vaadake seda Google Photos kus saate otsida konkreetset inimest või õnnelikke inimesi enda piltidelt. See on ka potentsiaalsete klientide soovitud funktsioon number üks, kuid Google keeldub seda edasi arendamast. Võimalik kahju on piisav, et Google keelduks selle eest raha võtmast.

Ka Google pooldab nii riiklikku kui ka sisemist regulatsiooni. See on ühtaegu üllatav ja oluline, sest võrdsed mängutingimused, mida ükski ettevõte ei suuda luua kahjulik AI on midagi, mis nii Google'i kui ka Microsofti arvates kaalub üles mis tahes potentsiaalse sissetuleku või rahaline kasu.

Mulle avaldas enim muljet Google'i vastus, kui küsisin täpsuse ja eetika tasakaalustamise kohta. Selliste asjade nagu taimede tuvastamise puhul on täpsus väga oluline, samas kui eelarvamus on vähem oluline. Näiteks kellegi soo tuvastamiseks fotol on mõlemad võrdselt olulised. Google jagab AI osadeks, mida ta nimetab viiludeks; iga viil teeb erinevat asja ja tulemust hindab tulemuste kontrollimiseks reaalsete inimeste meeskond. Kohandeid tehakse seni, kuni meeskond on rahul, siis võib edasi areneda.

Ükski neist pole täiuslik ja me kõik oleme näinud tehisintellekti tegemas või kordamas väga rumalaid asju, mõnikord isegi haiget tekitavaid asju. Kui need eelarvamused ja eetilised rikkumised võivad jõuda ühte tootesse, võivad nad (ja leiavad) tee kõigisse.

Oluline on see, et tulevikutarkvara arendavad ettevõtted seda tunnistaksid ja püüaksid protsessi jätkuvalt täiustada. See ei saa kunagi olema täiuslik, kuid seni, kuni iga iteratsioon on parem kui viimane, liigume õiges suunas.