Pravděpodobně jste slyšeli nebo četli lidi mluvit o etické umělé inteligenci. Zatímco počítače ve skutečnosti nedokážou myslet, a proto nemají žádnou skutečnou zaujatost nebo smysl pro odpovědnost, lidé vyvíjející software, který to všechno pohání, to určitě dělají, a proto je to důležité.

Není snadné to popsat nebo si všimnout. To nic neubírá na tom, jak důležité je, že velké technologické společnosti, které vyvíjejí produkty pro spotřebitele poháněné umělou inteligencí, to dělají správně. Pojďme se podívat na to, co to je a co se dělá pro to, aby umělá inteligence dělala naše životy lepšími než horšími.

AI není nic jiného než kus softwaru, který něco přijme, zpracuje a něco jiného vyplivne. Opravdu, to dělá veškerý software. AI se liší tím, že výstup se může výrazně lišit od vstupu.

Android & Chill

Jeden z nejdéle běžících technologických sloupců na webu, Android & Chill je vaše sobotní diskuse o Androidu, Googlu a všech technických záležitostech.

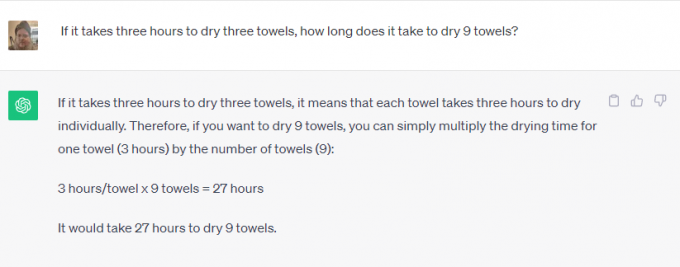

Vzít ChatGPT nebo

Google Bard například. Můžete požádat buď o vyřešení matematických úloh, vyhledat něco na webu, říct vám, kdy zemřel Elvis Presley, nebo vám napsat krátký příběh o historii katolické církve. Nikoho by nenapadlo, že ho můžete použít tvůj telefon za to před pár lety.Některé z nich jsou docela snadné úkoly. Software, který je integrovaný s internetem, může získat informace o čemkoli a vrátit je zpět jako odpověď na dotaz. Je to skvělé, protože to může ušetřit čas, ale ve skutečnosti to není úžasné.

Jedna z těch věcí je však jiná. Software se používá k vytváření smysluplného obsahu, který využívá lidské způsoby a řeč, což není něco, co lze vyhledat na Googlu. Software rozpozná, na co se ptáte (napište mi příběh) a parametry, které se pro to mají použít (historická data o katolické církvi), ale zbytek se zdá úžasný.

Věřte nebo ne, ale v obou typech použití záleží na zodpovědném vývoji. Software o ničem magicky nerozhoduje a musí být trénován zodpovědně s využitím zdrojů, které jsou buď nezaujaté (nemožné), nebo ze všech stran stejně zaujaté.

Nechcete, aby Bard použil někoho, kdo si myslí, že Elvis je stále naživu, jako jediný zdroj pro den, kdy zemřel. Také byste nechtěli, aby někdo, kdo nenávidí katolickou církev, naprogramoval software používaný k napsání příběhu o ní. Oba úhly pohledu je třeba zvážit a porovnat s jinými platnými hledisky.

Na etice záleží stejně jako na udržení přirozené lidské zaujatosti na uzdě. Společnost, která může něco vyvinout, se musí ujistit, že je používána zodpovědně. Pokud to nedokáže, musí to vůbec nevyvíjet. To je kluzký svah – takový, který je mnohem těžší zvládnout.

Společnosti, které vyvíjejí složitý software pro umělou inteligenci, jsou si toho vědomy a věří tomu nebo ne, většinou se řídí pravidlem, že některé věci by se prostě neměly vyrábět, i když umět být vyroben.

Oslovil jsem Microsoft i Google ohledně toho, co se dělá, aby se AI používala zodpovědně. Microsoft mi řekl, že nemají nic nového ke sdílení, ale nasměroval mě na řadu firemních odkazů a blogových příspěvků na toto téma. jejich čtení ukazuje, že Microsoft je oddán „zajistit, aby pokročilé systémy umělé inteligence byly bezpečné, zabezpečené a důvěryhodné“ v souladu se současnou politikou a osnovami USA jeho vnitřní normy velmi podrobně. Microsoft má v současnosti celý tým pracovat na zodpovědné AI.

Oproti tomu Google má kromě již zveřejněných prohlášení co říci. Nedávno jsem se zúčastnil prezentace na toto téma, kde vedoucí zaměstnanci společnosti Google řekli, že jediným závodem v oblasti umělé inteligence, na kterém záleží, je závod o zodpovědnou umělou inteligenci. Vysvětlili, že jen proto, že je něco technicky možné, není dostatečným důvodem k tomu, aby produkt dostal zelenou: škodí je třeba identifikovat a zmírnit jako součást vývojového procesu, aby je pak bylo možné použít k dalšímu zdokonalování proces.

Jako příklady bylo uvedeno rozpoznání obličeje a detekce emocí. Google je opravdu dobrý v obojím a pokud tomu nevěříte, podívejte se na to Fotky Google kde můžete hledat konkrétní osobu nebo šťastné lidi na svých vlastních obrázcích. Je to také funkce číslo jedna požadovaná potenciálními zákazníky, ale Google ji odmítá dále rozvíjet. Potenciální škoda je dostatečná k tomu, aby za ni Google odmítl vzít peníze.

Google také podporuje jak vládní nařízení, tak interní nařízení. To je překvapivé a zároveň důležité, protože rovné podmínky, které žádná společnost nemůže vytvořit škodlivá AI je něco, o čem si Google i Microsoft myslí, že převáží jakýkoli potenciální příjem resp finanční zisk.

Co na mě udělalo největší dojem, byla odpověď společnosti Google, když jsem se zeptal na vyvážení přesnosti a etiky. Pro něco jako identifikace rostlin je přesnost velmi důležitá, zatímco zkreslení je méně důležité. Pro něco, jako je určování něčího pohlaví na fotografii, je obojí stejně důležité. Google rozkládá umělou inteligenci na to, co nazývá řezy; každý plátek dělá jinou věc a výsledek je vyhodnocen týmem skutečných lidí, aby výsledky zkontrolovali. Úpravy se provádějí, dokud není tým spokojen, pak může dojít k dalšímu rozvoji.

Nic z toho není dokonalé a všichni jsme viděli AI dělat nebo opakovat velmi hloupé věci, někdy dokonce zraňující věci. Pokud si tyto předsudky a etická porušení mohou najít cestu do jednoho produktu, mohou (a také najdou) cestu do všech z nich.

Důležité je, že společnosti vyvíjející software budoucnosti si to uvědomují a neustále se snaží proces zlepšovat. Nikdy to nebude dokonalé, ale pokud bude každá iterace lepší než ta poslední, jdeme správným směrem.